Anstatt dass Message Credits (MCs) in bestehenden Abonnements enthalten sind, kaufen Sie sie separat ueber Add-ons – oder Sie verbinden Ihre eigene AI-API, um unbegrenzte Nutzung zu ermöglichen. Wenn Sie Ihren eigenen API-Schluessel verwenden, werden – nachdem alle MCs in Ihrem INNOCHAT-Konto aufgebraucht sind – alle weiteren KI-Kosten direkt über Ihren API-Schlüssel abgerechnet.

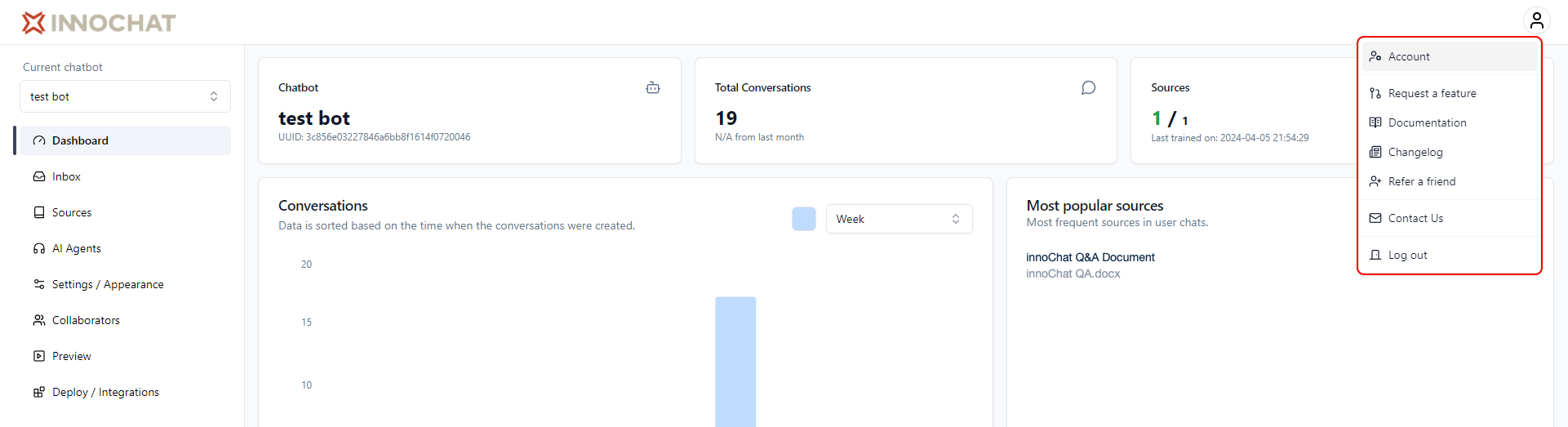

BYOK einrichten

Um Ihren eigenen API-Schluessel einzurichten, müssen Sie sich zuerst beim jeweiligen AI-Anbieter registrieren.INNOCHAT unterstützt derzeit LLMs von OpenAI, Anthropic und Google.

Zukünftig planen wir, weitere Modelle zu integrieren – einschliesslich Open-Source- und Fine-Tuned-Modelle.

Anbieter-spezifische Anweisungen

- OpenAI (GPT-Modelle) – https://platform.openai.com/account/api-keys

- Anthropic (Claude-Modelle) – https://console.anthropic.com/settings/keys

- Google (Gemini-Modelle) – https://ai.google.dev/gemini-api/docs/api-key

INNOCHAT empfiehlt dringend:

- Verwenden Sie für jede Anwendung einen separaten API-Schluessel

- Teilen Sie Ihren API-Schluessel nie mit anderen Personen

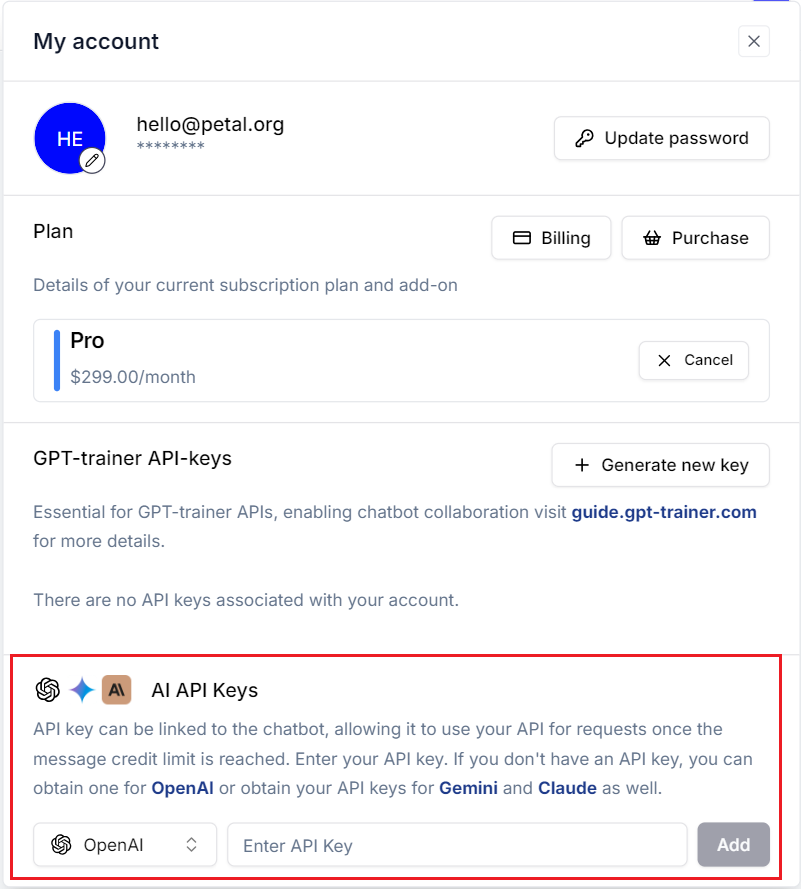

Im Bereich AI API Key waehlen Sie Ihren Provider aus und fügen den API-Schlüssel ein. Danach auf Add klicken. Bitte beachten:

Dies ist nicht der Bereich INNOCHAT API Keys, der fuer die Generierung von INNOCHAT-eigenen API-Schlüsseln dient.

Wenn Sie zum ersten Mal einen API-Schlüssel bei einem Anbieter erstellen, kann dieser eingeschränkt sein.

Beispiel (Stand 1. November 2024):

Neue OpenAI-Schluessel können keine GPT-4o Modelle verwenden, bis ein Mindestguthaben von 5 USD eingezahlt und die Abrechnung verifiziert wurde.

Jeder Anbieter hat eigene Richtlinien für Konto-Verifizierung und Limits.

Beispiel (Stand 1. November 2024):

Neue OpenAI-Schluessel können keine GPT-4o Modelle verwenden, bis ein Mindestguthaben von 5 USD eingezahlt und die Abrechnung verifiziert wurde.

Jeder Anbieter hat eigene Richtlinien für Konto-Verifizierung und Limits.

Budgetierung für AI-Nutzung

Die Verwendung Ihres eigenen API-Schlüssels ist in der Regel kosteneffizienter als der Kauf von MC-Add-ons. Zur Einschätzung der Kosten stellen wir folgende Referenz bereit:LLM-Anbieter ändern ihre Preise regelmässig.

Die aktuellsten Preise finden Sie hier:

Die aktuellsten Preise finden Sie hier:

- OpenAI (GPT): https://openai.com/pricing

- Anthropic (Claude): https://www.anthropic.com/pricing#anthropic-api

- Google (Gemini): https://ai.google.dev/pricing#1_5flash

Kosten: 0.0032 × 20 = 0.064 USD Dies ist nur ein grober Richtwert.

Die realen Kosten koennen um ± 20 % variieren, da LLM-Kosten auf Token basieren – und Input-/Output-Token unterschiedlich viel kosten. Eine Erklaerung zu Tokens finden Sie hier:

https://help.openai.com/en/articles/4936856-what-are-tokens-and-how-to-count-them Ein LLM-Query besteht aus vielen Elementen. Grob unterteilt: Input:

- System Prompt & Metadata

- Benutzerdefinierter Base Prompt

- Variablen & Definitionen

- Conversation-Label-Definitionen

- Function-Metadaten & Beschreibungen

- Function-Parameter

- Function-Response

- Statischer RAG-Kontext

- Conversation Memory

- Textantwort

- Response-Metadaten

OpenAI-Preisaufschlüsselung

INNOCHAT unterstuetzt verschiedene OpenAI-LLMs sowie unterschiedliche Token-Limits pro Modellvariante.Die folgende Tabelle basiert auf unserer Standardaufteilung von reservierten Input-/Output-Tokens.

Dies repraesentiert eine Obergrenze, da nicht bei jeder Anfrage die voll reservierten Tokens genutzt werden.

| Modell | Input-Reserve | Output-Reserve | Kosten/Input-Token | Kosten/Output-Token | Gesamt/Query |

|---|---|---|---|---|---|

| GPT-3.5 | 2800 | 1200 | 0.0000005 | 0.0000015 | 0.0032 |

| GPT-3.5-16k | 13600 | 2400 | 0.0000005 | 0.0000015 | 0.0104 |

| GPT-4o-mini-1k | 800 | 200 | 0.00000015 | 0.0000006 | 0.00024 |

| GPT-4o-mini-2k | 1600 | 400 | 0.00000015 | 0.0000006 | 0.00048 |

| GPT-4o-mini-4k | 2800 | 1200 | 0.00000015 | 0.0000006 | 0.00114 |

| GPT-4o-mini-8k | 5600 | 2400 | 0.00000015 | 0.0000006 | 0.00228 |

| GPT-4o-mini-16k | 12800 | 3200 | 0.00000015 | 0.0000006 | 0.00384 |

| GPT-4o-mini-32k | 28000 | 4000 | 0.00000015 | 0.0000006 | 0.0066 |

| GPT-4o-mini-64k | 60000 | 4000 | 0.00000015 | 0.0000006 | 0.0114 |

| GPT-4o-1k | 800 | 200 | 0.0000025 | 0.00001 | 0.004 |

| GPT-4o-2k | 1600 | 400 | 0.0000025 | 0.00001 | 0.008 |

| GPT-4o-4k | 2800 | 1200 | 0.0000025 | 0.00001 | 0.019 |

| GPT-4o-8k | 5600 | 2400 | 0.0000025 | 0.00001 | 0.038 |

| GPT-4o-16k | 12800 | 3200 | 0.0000025 | 0.00001 | 0.064 |

| GPT-4o-32k | 28000 | 4000 | 0.0000025 | 0.00001 | 0.11 |

| GPT-4o-64k | 60000 | 4000 | 0.0000025 | 0.00001 | 0.19 |

| GPT-4-1106-1k | 800 | 200 | 0.00001 | 0.00003 | 0.014 |

| GPT-4-1106-2k | 1600 | 400 | 0.00001 | 0.00003 | 0.028 |

| GPT-4-1106-4k | 2800 | 1200 | 0.00001 | 0.00003 | 0.064 |

| GPT-4-0125-8k | 5600 | 2400 | 0.00001 | 0.00003 | 0.128 |

| GPT-4-1106-16k | 12800 | 3200 | 0.00001 | 0.00003 | 0.224 |

| GPT-4-1106-32k | 28000 | 4000 | 0.00001 | 0.00003 | 0.4 |

| GPT-4-1106-64k | 60000 | 4000 | 0.00001 | 0.00003 | 0.72 |

BYOK fuer White-Label-Partner

Zusätzlich zu MC-Kosten muessen White-Label-Partner auch die Kosten tragen, die durch das Ausfuehren des AI-Multi-Agenten-Frameworks entstehen.Diese Kosten fallen an, selbst wenn Ihre Endnutzer ihre eigenen API-Schluessel verwenden. Es gibt drei Workflows, die Ihre API belasten:

-

AI Agent Intent Generation

- Wenn zwei oder mehr AI-Agenten verbunden sind

- Wird berechnet, wenn ein neuer user-facing Agent live geht oder ein bestehender bearbeitet wird

-

Query Intent Classification

- Wenn zwei oder mehr user-facing Agenten aktiv sind

- Preis pro Anfrage

-

Variable Extraction

- Wenn ein Agent eine oder mehrere Variablen nutzt

- Preis pro Anfrage

| Workflow | Input | Output | Cost/Input | Cost/Output | Cost/Run |

|---|---|---|---|---|---|

| Intent Generation (gpt-4-1106-preview) | 600 | 450 | 0.00001 | 0.00003 | 0.0011 |

| Query Intent Classification (gpt-3.5-turbo-1106) | 1000 | 50 | 0.000001 | 0.000002 | 0.0195 |

| Variable Extraction (gpt-3.5-turbo-1106) | 1000 | 100 | 0.000001 | 0.000002 | 0.0012 |

Wir aktualisieren die Dokumentation entsprechend.

Im Allgemeinen sind diese Zusatzkosten jedoch gering im Vergleich zu den Kosten, die durch Message Credits entstehen.